Spis treści

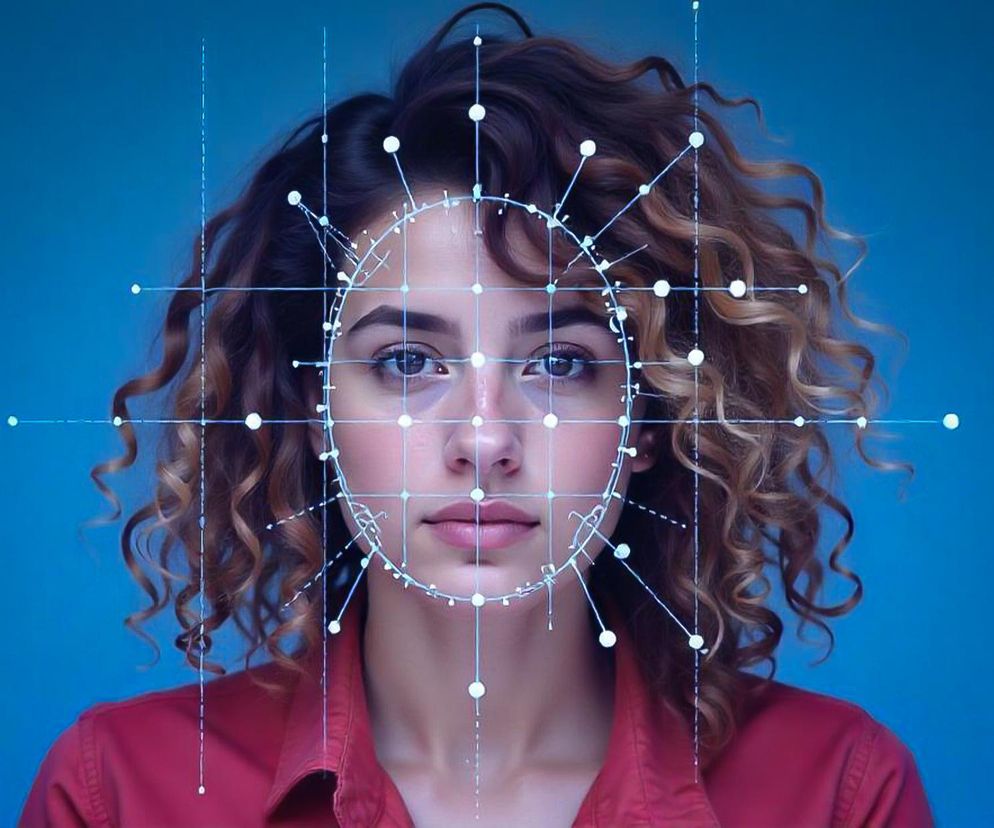

Deepfake to technologia wykorzystująca sztuczną inteligencję do tworzenia realistycznych, lecz fałszywych obrazów lub nagrań wideo. Dzięki zaawansowanym algorytmom komputer potrafi nakładać twarz jednej osoby na nagranie innej. Choć technologia ta może być wykorzystywana w branży rozrywkowej, np. do odtwarzania zmarłych aktorów lub tworzenia efektów specjalnych, niesie ze sobą również ryzyko manipulacji i dezinformacji, szczególnie jeśli wpadnie w niepowołane ręce. Najgorsze, że za chwilę każdy będzie mógł stać się właścicielem narzędzi, które na to pozwalają.

Narzędzie deepfake, które podmienia twarz na żywo

Jedno zdjęcie, jedno narzędzie i jedno kliknięcie - tyle dzieli nas od wcielenia się w inną osobę. DeepFaceLive to nowatorskie rozwiązanie, o którym było już głośno kilka miesięcy temu. Głośno jest i dzisiaj, ponieważ twórcy tego oprogramowania stale go rozwijają. Narzędzie umożliwia podmianę twarzy w czasie rzeczywistym podczas transmisji na żywo i rozmów wideo. Dostosuje ruch ust, a nawet dostosuje się do warunków oświetlenia. Wszystko dzięki potężnym algorytmom, tzw. GFPGAN i inswapper.

Narzędzie zostało stworzone do celów artystycznych, np. do animowania postaci na potrzeby filmów i animacji. Twórca zdaje sobie sprawę z niebezpieczeństwa, jakie ze sobą niesie i dąży do tego, aby w przypadku wykrycia nielegalnego zastosowania przerwać nakładanie twarzy lub rozwiązać sprawę za pomocą widocznych znaków wodnych. Dodaje, że trzeba mieć zgodę na wykorzystanie cudzego wizerunku. Lekko pocieszający fakt jest taki, że podmiana twarzy na żywo daje jednak najlepsze efekty na drogich i najlepszych sprzętach, na które nie wszyscy mogą sobie pozwolić.

Deepfake to poważny problem. Jakie niesienie zagrożenia?

Wyobraź sobie, że dzwoni do ciebie koleżanka, np. na FaceTime lub Messengerze. Widzisz ją, rozmawiacie o sprawach osobistych lub przelewacie sobie pieniądze. Później się okazuje, że... to oszust, który podmienił sobie twarz. Teraz ma albo gotówkę, albo wie o tobie więcej, niż powinien. Problem jest na tyle poważny, że takie sytuacje mają już miejsce. Już przecież podczas prawdziwych rozmów online często zniekształca nam się obraz i głos na różne sposoby, co sprawia, że dzisiaj trudno rozróżnić, czy mamy styczność z "fejkiem", czy jednak nie.

Wszystko wskazuje na to, że na przestrzeni najbliższych lat, a nawet miesięcy, nie będziemy mogli już ufać nikomu i niczemu, co widzimy w internecie. Warto przypomnieć, że nie tak dawno przewodniczący Komisji ds. Stosunków Zagranicznych Senatu USA omyłkowo odbył rozmowę wideo z kimś, kto podszywał się pod ukraińskiego urzędnika. Mieliśmy też przykład międzynarodowej korporacji, która straciła MILIONY DOLARÓW na początku 2024 roku, gdy jeden z pracowników został oszukany przez deepfake'ową rozmowę wideo. Już dzisiaj oszuści wcielają się w prezesów, pracowników i włamują się na wideokonferencje.

Jak walczyć z deepfake'ami? Potencjalne rozwiązania

W sieci natrafiłem ostatnio na komentarz, który brzmiał, że dzięki takim oszustwom może nareszcie przestaniemy rozmawiać online i wyjdziemy "do ludzi". W sumie jest to jakaś opcja. Z kolei, jeżeli chodzi o inne rozwiązania, to mamy m.in. startup Reality Defender, który tworzy oprogramowanie do wykrywania deepfake'ów. Już teraz radzi sobie nie najgorzej, ale temat i tak jeszcze raczkuje. Według prezesa firmy, Bena Colmana, takie oszustwa będą się rozwijać i to, co widzimy teraz, to dopiero przedsmak, a wielkie "boom" na deepfake dopiero nadejdzie.

To już prawdopodobnie kwestia miesięcy, zanim zaczniemy obserwować falę deepfake'owych filmów i oszustw na twarz. Jeśli chodzi o rozmowy wideo, szczególnie te o wysokim ryzyku, nie powinieneś wierzyć w to, co zobaczysz." - powiedział Ben Colman, CEO Reality Defender

Rozwiązania Reality Defender będą jednak skierowane dla rządu oraz firm. Nie ochronią, przynajmniej na ten moment, zwykłego Kowalskiego. Bardzo prawdopodobne, że za chwilę zaczniemy korzystać z cyfrowego paszportu, takiego dowodu osobistego, który potwierdza fakt bycia człowiekiem. Prawdziwą, konkretną osobą. Jest już taki projekt, nazywa się World ID. World ID ma być receptą na deepfake i niebezpieczną technologię, działając na zasadzie skanowania tęczówki oka. Projekt działa już w Japonii, Korei Południowej, a nawet w Niemczech. Budzi jednak obawy co do prywatności i ochrony danych osobowych. Na tę chwilę pozostaje nam chyba tylko być na bieżąco z nowinkami technologicznymi, wiedzieć, że takie narzędzia do manipulacji istnieją, aby przynajmniej w jakimś stopniu zmniejszyć ryzyko stania się bohaterem oszustwa.

Źródło: ArsTechnica.com, DeepLiveCam.org, WIRED

![Cena karpia w Kujawsko-Pomorskiem 2025. Ile kosztuje kilogram żywej ryby z wody od lokalnych hodowców? [GALERIA]](https://cdn.galleries.smcloud.net/thumbs/gf-nuMx-zeCW-JKRs_ile-kosztuje-kilogram-zywego-karpia-z-wody-od-lokalnych-hodowcow-3-j.jpg)

![Jedyny w Polsce jarmark świąteczny na moście znów zachwyca. Ceny, atrakcje, produkty! Ile zapłacimy w tym roku? [GALERIA]](https://cdn.galleries.smcloud.net/thumbs/gf-JFWQ-zzB5-ktyr_ceny-atrakcje-produkty-3-j.jpg)